Editorial

Intelligence artificielle et santé : ce que la machine promet, ce que les médecins redoutent, ce que les patients risquent

Depuis quelques semaines, des articles circulent sur le lancement, aux États-Unis, de versions “santé” d’assistants d’intelligence artificielle. Certains parlent déjà d’une arrivée prochaine en France. Le mot “ChatGPT santé” est lâché. Et avec lui, une angoisse sourde, presque palpable, chez de nombreux professionnels.

- EvgeniyShkolenko/Istock

Il y a des mots qui, en santé, provoquent immédiatement un réflexe de crispation.

L’intelligence artificielle en fait désormais partie.

Non pas parce qu’elle serait absurde ou marginale.

Mais précisément parce qu’elle est déjà là, qu’elle avance vite, et qu’elle touche à ce que le système de santé a de plus sensible :

la décision, la responsabilité, la relation humaine.

Depuis quelques semaines, des articles circulent sur le lancement, aux États-Unis, de versions “santé” d’assistants d’intelligence artificielle. Certains parlent déjà d’une arrivée prochaine en France. Le mot “ChatGPT santé” est lâché. Et avec lui, une angoisse sourde, presque palpable, chez de nombreux professionnels.

Cette peur mérite mieux que des caricatures.

Elle mérite d’être prise au sérieux.

La peur de l’IA n’est pas une peur technophobe. C’est une peur professionnelle.

Contrairement à ce que certains discours laissent entendre, les médecins ne rejettent pas l’IA par conservatisme. Ils la rejettent – ou s’en méfient – parce qu’ils ont déjà vécu plusieurs vagues de “progrès” présentées comme libératrices… et qui se sont souvent traduites par plus de contraintes, plus de bureaucratie, plus de pression, et moins de temps médical.

Derrière l’IA, ils entendent :

- automatisation,

- standardisation,

- perte de maîtrise,

- dilution de la responsabilité,

- et, en filigrane, disparition de métiers.

Cette crainte n’est pas fantasmatique.

Dans d’autres secteurs, elle s’est révélée fondée.

La question n’est donc pas : “l’IA est-elle performante ?”

La vraie question est : à qui sert-elle, et qui paiera ses erreurs ?

La promesse technologique ne vaut rien sans fiabilité démontrée

En médecine, l’intention ne suffit pas.

La promesse non plus.

Un outil peut être impressionnant, fluide, rapide, pédagogique… et dangereux s’il n’est pas rigoureusement encadré. La fiabilité, en santé, ne se mesure pas au taux de satisfaction utilisateur. Elle se mesure à la capacité à :

- ne pas induire en erreur,

- ne pas simplifier à l’excès,

- ne pas masquer l’incertitude,

- ne pas produire une fausse assurance.

Or, l’intelligence artificielle générative a une caractéristique problématique :

elle parle bien, même quand elle ne sait pas.

Ce n’est pas un détail.

C’est un point de rupture avec la culture médicale, fondée sur le doute, la hiérarchisation des hypothèses, la prudence, le “je ne sais pas encore”.

Un outil qui explique sans signaler ses limites peut devenir un outil de désinformation sophistiquée.

Et en santé, une mauvaise information est parfois plus dangereuse qu’une absence d’information.

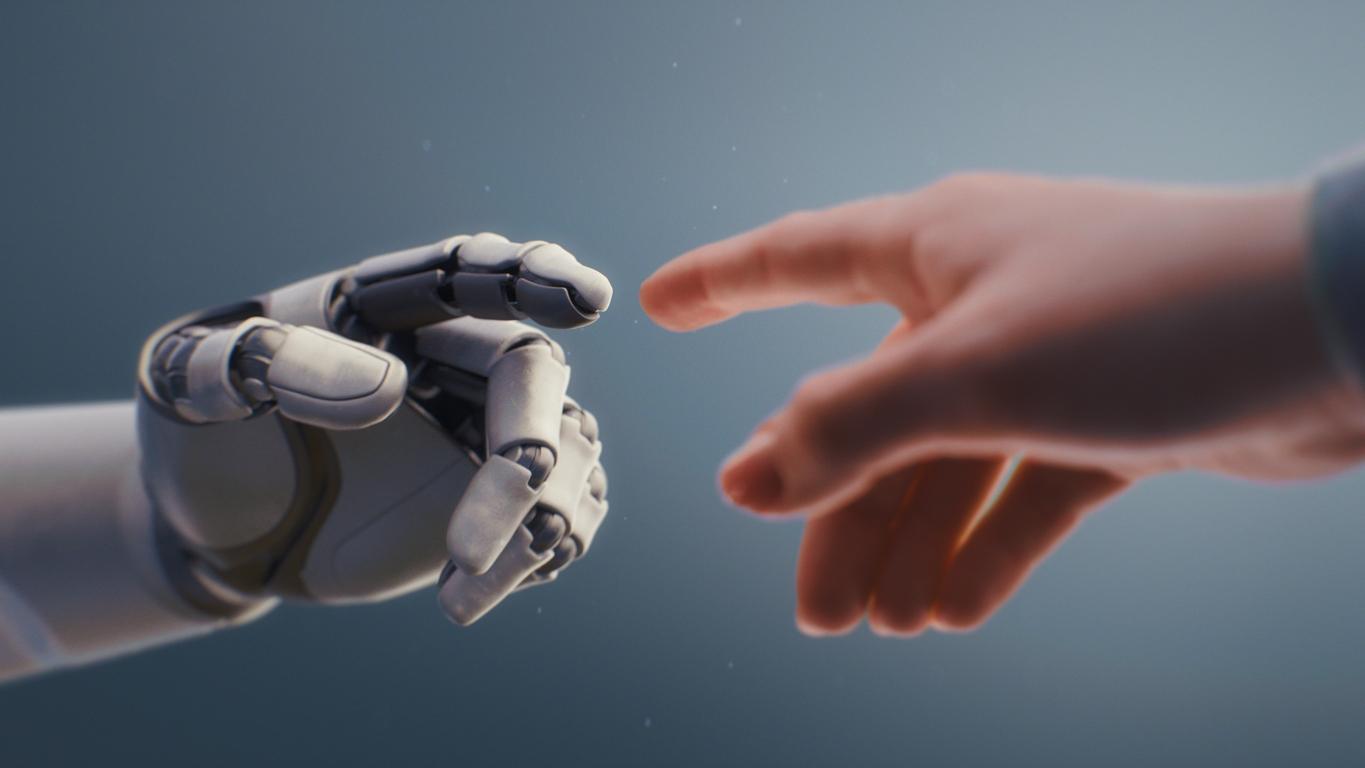

Le risque n’est pas que l’IA remplace le médecin. Le risque est qu’elle s’interpose.

Le scénario catastrophe n’est pas celui d’un robot en blouse blanche.

Il est beaucoup plus subtil.

Le vrai risque, c’est celui d’un tiers numérique qui :

- reformule les symptômes,

- oriente les inquiétudes,

- hiérarchise les urgences,

- influence les décisions en amont de la consultation,

sans être ni responsable, ni traçable, ni redevable.

Dans ce scénario, le médecin ne disparaît pas.

Mais il arrive après.

Après que l’angoisse a été amplifiée.

Ou, au contraire, après qu’un signal d’alerte a été minimisé.

C’est là que la fiabilité devient un enjeu politique, pas seulement technologique.

Les patients, eux, n’attendent pas. Ils utilisent déjà ces outils.

C’est sans doute le point le plus dérangeant du débat.

Pendant que les institutions réfléchissent, pendant que les autorités temporisent, les patients utilisent déjà l’IA :

- pour comprendre un compte rendu,

- pour interpréter un symptôme,

- pour préparer une consultation,

- pour comparer des avis.